Ein ‘Deep Neural Network’ enthält in der Regel eine sehr große Anzahl von Parametern – Millionen oder sogar Milliarden – die während des Trainings gelernt werden; eine Komplexität, die für die nichtlinearen internen Darstellungen der Eingabedaten erforderlich ist. Diese Installation visualisiert einige Aspekte des Innenlebens eines ‘Deep Neural Network’ für eine Musikkomposition namens Ricercar, die im Ars Electronica Futurelab entwickelt wird.

Ricercar wird mit 25.000 Musikstücken trainiert und kann Musik komponieren. In diesem Fall komponiert das Netzwerk jedoch nicht, sondern wird mit einem bestehenden Musikstück als Input gespeist.

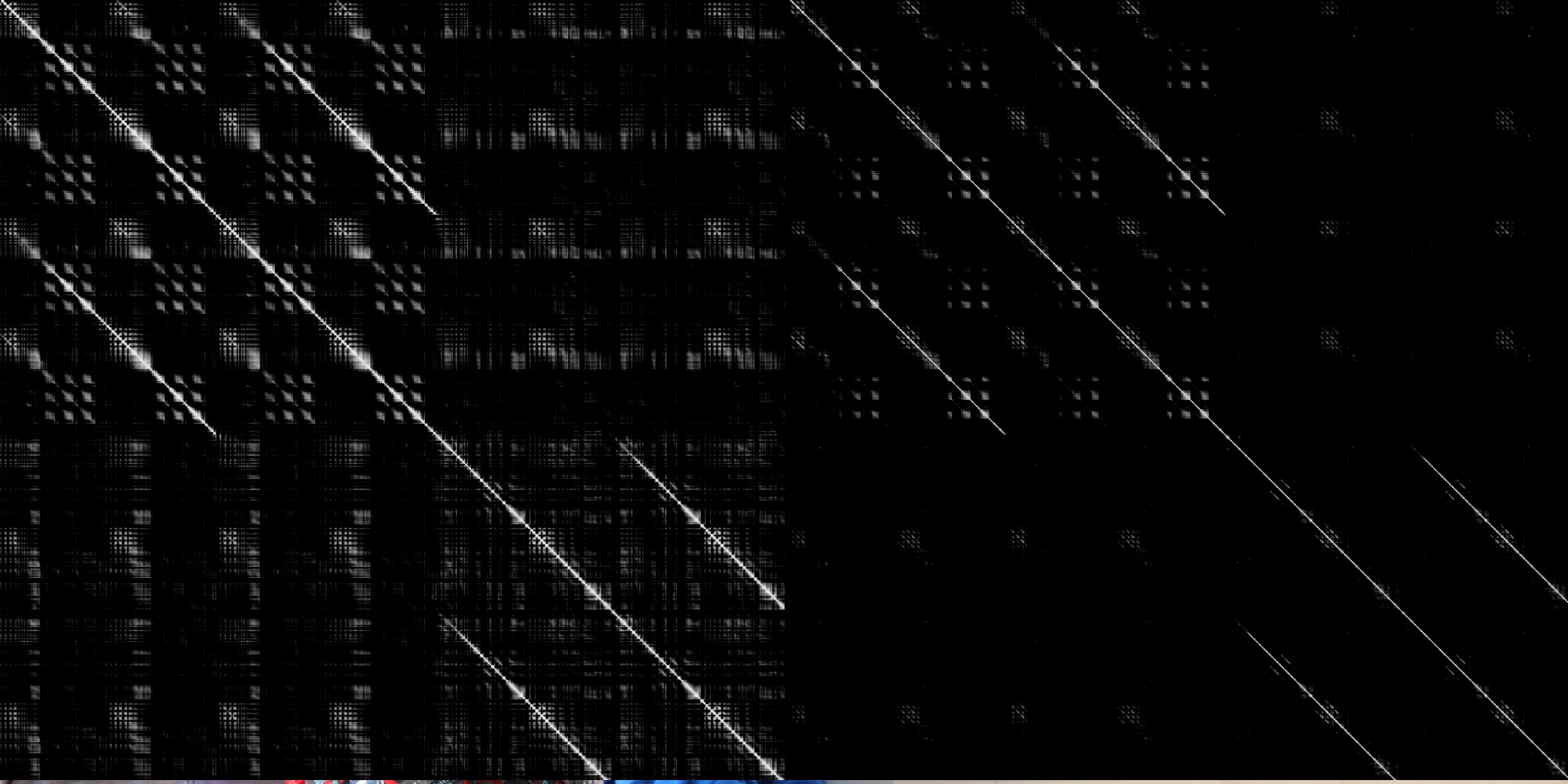

Während die Musik läuft, beobachten wir die Reaktion der Neuronen in jeder Schicht, die uns jeden Moment im Stück zeigen, in dem Neuronen aktiviert werden und darauf reagieren. Schließlich zeigt eine sogenannte similarity matrix (dt.: Ähnlichkeitsmatrix) die Ähnlichkeit zwischen den aktivierten Neuronen zu jedem Zeitpunkt miteinander. Mit anderen Worten, sie verdeutlicht, welche Teile im Stück ähnlich sind, da sie die Aktivierung ähnlicher Neuronen erzeugen.

Das Ergebnis ist eine neuartige Art der Visualisierung von Musik, die die übergeordneten Strukturen eines Musikstücks (z.B. seine sich wiederholenden Strukturen) zum Ausdruck bringt. So veranschaulicht sich, dass Musik nicht nur angenehm zu hören ist, sondern auch schöne verborgene visuelle Strukturen enthält, die sich über das gesamte Stück erstrecken können.