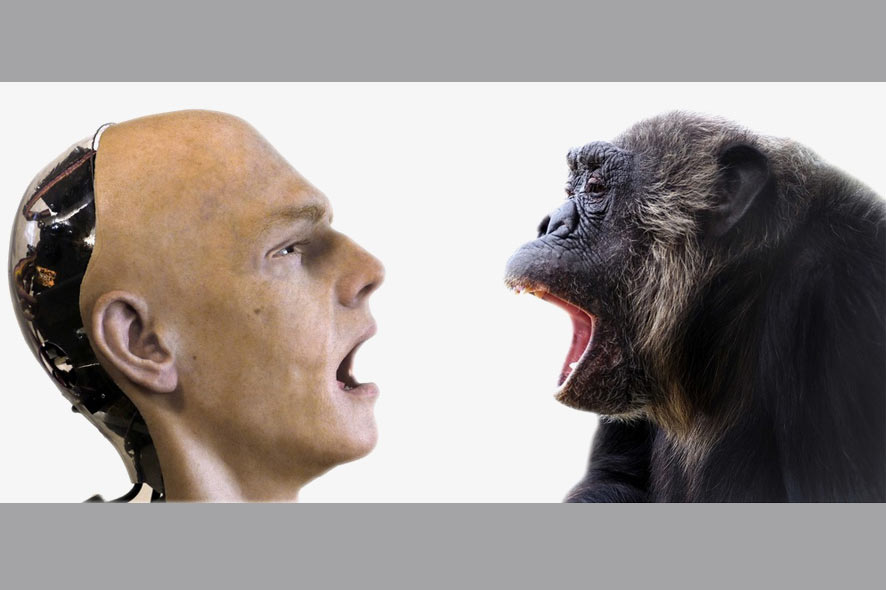

Wer an diesen Sommertagen durch die Stadt Linz rollt oder spaziert, kommt an dem Bild wohl kaum vorbei: Ein menschlicher Roboter, ein Android, gähnt unverschämt einen gähnenden Schimpansen an. Hinter diesem Sujet zum Ars Electronica Festival 2017, das von 7. bis 11. September 2017 in Linz stattfinden wird, steckt das Projekt „Beyond Humans“ von Ramiro Joly-Mascheroni, Wissenschaftler der City University of London. Was es damit auf sich hat und was er über künstliche Intelligenz denkt, das hat er uns vor kurzem in einem Interview erzählt.

Worum geht es bei Ihrem Beyond-Humans-Projekt?

Ramiro Joly-Mascheroni: Das, was wir tun, könnte man so zusammenfassen: Mit den Mitteln der Kunst, der Ästhetik, der künstlichen Intelligenz und Technologie erforschen wir die soziale Interaktion und die multisensorische Integration von Ereignissen rund um uns. Die wissenschaftliche Forschung in den Neurowissenschaften, in der Evolutionspsychologie und in der Philosophie konzentriert sich ja immer mehr auf künstliche Akteure und die dazugehörige menschliche Interaktion. Gerade in der Ära der rasanten technologischen Fortschritte sollten wir uns immer mehr den Funktionen des Gehirns zuwenden, um besser verstehen zu können, wie wir Handlungen wahrnehmen, wie wir die Handlungen anderer verstehen und warum wir manchmal versucht sind, menschliche Verhaltensweisen oder Eigenschaften auf nicht-menschliche Akteure und Maschinen zu übertragen.

Das Projekt „Beyond Humands“ ist Teil meiner Doktorandenforschung am „Cognitive Neuroscience Research Unit“ an der City University of London, die in Zusammenarbeit mit dem Mona Chimpanzee Sanctuary entstand. Wir verwenden einen Androiden und neuropsychologische Methoden, wie beispielsweise Verhaltens- oder Bildgebungsverfahren, die es uns möglich machen, die neuronalen Mechanismen und motorischen Prozesse zu erforschen, die an der Wahrnehmung, der Interpretation und an der Darstellung der Mimik oder anderen motorischen Handlungen beteiligt sind – hier liegt der Schwerpunkt vor allem auf der „Körpersprache“ des Gesichts, der Mimik, die wesentlich für soziale Kommunikation und Interaktion von Menschen und Tieren ist.

Beyond Humans ist das Festival-Sujet 2017. Credit: Ars Electronica / Martin Hieslmair

Können Sie uns etwas mehr über das Ziel des Projekts erzählen?

Ramiro Joly-Mascheroni: Über den Prozess der Evolution haben Tiere und Menschen neuronale Mechanismen mit präzisen funktionalen Spezialisierungen entwickelt. Schon frühere Studien zeigten, dass bestimmte Hirnregionen des Menschen für die Verarbeitung von Gesichtern unentbehrlich sind. Wir wissen auch, dass andere Gehirnbereiche des Menschen wichtig für das Verstehen und das Ausführen von Bewegungen sind – ganz egal ob es unsere eigenen sind oder die der anderen. Einige dieser Gehirnbereiche können sich manchmal überschneiden, und wir fragen uns, ob diese Bereiche genau den neuronalen Stoff dafür liefern, um Handlungen von anderen wahrzunehmen, zu verstehen und darauf reagieren zu können. Einige dieser Handlungen, mit denen wir andauern konfrontiert sind, und die wir laufend interpretieren, sind also Mimik und kommunikative Ausdrücke. Beyond Humans begann damit, dass wir zum ersten Mal den Austausch von kommunikativen Gesten über mehrere Arten hinweg untersuchten. Anfangs begannen wir die Forschung zwischen Hunden und Menschen, dann folgten wir immer mehr dem evolutionären Weg zu unseren nächsten genetischen Vorfahren, den Schimpansen. Nun ist unsere Forschung dort angelangt, wo wir nicht mehr von „zwischen den Arten“ sprechen können. Wir haben die künstliche Intelligenz miteingeschlossen, wir erforschen nun auch „kommunikative Akteure“.

Was ist so besonders an dieser Gähnbewegung, die auf dem Festival-Sujet zu sehen ist?

Ramiro Joly-Mascheroni: Ein Teil unserer Forschung verwendet einfache alltägliche Handlungen wie das Gähnen, um eher komplizierte neurokognitive Mechanismen zu erforschen. Wir glauben, dass dies für die laufende Forschung von sozialer Kommunikation und Interaktion von Mensch und Tier sehr wichtig ist. Im Gegenzug hilft uns diese Forschung zu erkennen, wie wir die Handlungen anderer Menschen wahrnehmen und interpretieren, wenn wir eine sensorische Beeinträchtigung haben, beispielsweise verursacht durch eine Gehirnverletzung oder durch einen allmählichen Verlust der Sinneswahrnehmungen. Eine der spannendsten Ergebnisse unserer Forschung ist auch der Beitrag, den wir für SSDs, für sensorische Substitutionsgeräte, leisten können. Diese Studien zielen darauf ab, sehbeeinträchtigen und taubblinden Kindern dabei zu helfen, Handlungen anderer Menschen wahrzunehmen und diese richtig zu interpretieren, damit sie schließlich erfolgreich kommunizieren und miteinander interagieren können.

Manchmal beobachten wir Aktionen bei Anderen, die wir eigentlich nicht imitieren wollen, aber es dennoch tun. Sie lösen regelecht den Drang in den BetrachterInnen aus, die gleiche Handlung auszuführen, und sich davon „anstecken“ zu lassen. Die besten Beispiele für solche ansteckenden Handlungen sind das Lachen und das Gähnen. Wir wissen, wie es sich anfühlt, wenn wir diese Handlungen selbst ausführen, und unsere Wahrnehmungssysteme sind so feinfühlig, dass wir die Handlung in unserem Körper fühlen können. Diese rasche und fast automatische Antwort kann bei den BetrachterInnen dazu führen, dass sie dieselbe motorische Handlung ausführen, obwohl sie es eigentlich nicht bewusst oder absichtlich geplant hatten.

Genau in diesem Feld der Wahrnehmung von Körperbewegungen wurde ein spezialisiertes „neuronales Spiegelungssystem“ entdeckt, das sogenannte Mirror Neuron System (MNS). Dieses neuronale Netzwerk scheint aktiv zu sein, wenn wir bestimmte Handlungen durchführen oder beobachten. Besonders interessant für unsere Forschung ist, dass dieses System für die visuelle und motorische Ähnlichkeit zwischen den BeobachterInnen und AkteurInnen sehr feinfühlig ist.

Wissenschaftliche Studien fanden heraus, dass diese Gehirnareale auch aktiv sind, wenn jemand einen anderen beim Gähnen beobachtet und schließlich auch selbst gähnen muss. Wenn man also jemanden beim Gähnen beobachtet, das Wort „gähnen“ liest, sich ein Video des Gähnens ansieht oder selbst nur auf ein Foto eines Gähnenden blickt, kann das bei den BetrachterInnen zum Gähnen führen.

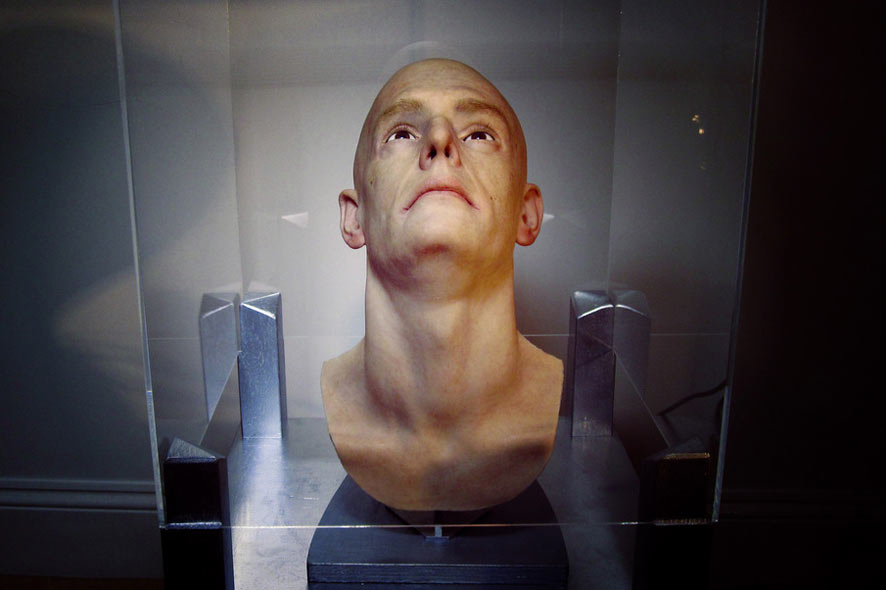

„Andere Studien, die sich mit Robotern und Avataren beschäftigten, haben gezeigt, dass auch Aktionen von Robotern das motorische System der menschlichen BetrachterInnen ansprechen können. Deshalb haben wir diesen Androiden entwickelt, der verschiedene Arten an Mimik ausführen kann – einschließlich des Gähnens, des Lachens und des Stirnrunzelns.“

Credit: Ramiro Joly-Mascheroni

Warum beschäftigt sich die wissenschaftliche Forschung immer mehr mit künstlichen Akteuren und menschlicher Interaktion?

Ramiro Joly-Mascheroni: In den Bereichen wie Neurowissenschaften, Robotik und künstlicher Intelligenz gibt es ein zunehmendes Interesse an der Erforschung der Akzeptanz und der Reaktionen auf künstlich erzeugte und unbelebte Objekte wie Androiden oder Roboter. Unsere Arbeit schließt Anthropologie und Evolutionspsychologie mit ein und untersucht einfache neuropsychologische Fragestellungen genauso wie kompliziertere philosophische Fragen. Wir möchten untersuchen, wie Menschen sozial miteinander interagieren. Aus einer vergleichenden Perspektive versuchen wir zu verstehen, wie Tiere miteinander kommunizieren, und aus einer evolutionären Perspektive versuchen wir unsere Erkenntnisse bis zurück zum Ursprung unserer Sprache zu verfolgen.

Dieses androide Gähnen reichte aus, um Schimpansen zum Gähnen zu bringen. Die Handlungen dieses unbelebten Akteurs führten dazu, dass die Botschaft von den Tieren übernommen wurde. Die Ergebnisse unserer Studie deuten darauf hin, dass Schimpansen in der Lage sind, ein kommunikatives Signal von einem menschenähnlichen Wesen aufzunehmen, das letztendlich ein Android ist. Dieses Ergebnis ist ein wichtiger Beweis dafür, dass Evolutionstheorien und vergleichende Perspektiven rund um Wahrnehmung das Verständnis von Handlungen relevant sind. Die Erkenntnis, dass unser genetisch engster Primat das Gähnen stets von einem künstlichen Objekt ableiten kann, ist neu und interessant zugleich. Das alte Phänomen des ansteckenden Gähnens könnte somit ein Teil einer vorsprachenhaften Form der Kommunikation gewesen sein.

„Das Gähnen könnte schon immer eine nonverbale kommunikative Rolle gespielt haben, und dessen Aspekte der „Ansteckung“ können uns helfen, mehr darüber zu verstehen, wie Menschen und Tiere adaptive Funktionen, Kommunikationswege und soziale Interaktionen entwickelten.“

Was sind Ihrer Meinung nach die Vorteile und Risiken von künstlicher Intelligenz?

Ramiro Joly-Mascheroni: Wir untersuchen in der Tat die möglichen Vor- und Nachteile bei der Verwendung von Akteuren mit künstlicher Intelligenz. Dieser besondere Roboterkopf wurde mit Hilfe von preisgekrönten Prothetik- und Spezialeffekt-ExpertInnen entwickelt – in Kooperation mit NeurowissenschaftlerInnen, PrimatologInnen, sehbeinträchtigen Menschen, SchlaganfallpatientInnen, PhysiotherapeutInnen, LehrerInnen und anderen FachpädagogInnen. Das hat uns bereits interessante Einblicke auf die Auswirkungen des technologischen Fortschritts bei künstlicher Intelligenz gegeben. Diese wohlgemeinten Fortschritte stellen uns aber auch vor wichtigen moralischen Dilemmata.

Denken wir doch einfach an ein mögliches Szenario, das immer wieder in der Entscheidungsfindung verwendet wird. Seit einigen Jahren sind auf einigen Zugstrecken Züge ohne Personal unterwegs. Ein fahrerloser Zug nähert sich einer Kreuzung. Wenn der Computer oder der Roboter den Zug steuert und dieser auf seiner bisherigen Bahn bleibt, würde eine Gruppe von fünf daran arbeitenden Menschen getötet werden. Wenn der Computer oder der Roboter den Zug auf das andere Gleis steuert, würde ein Mensch getötet werden. Also, was soll der Roboter tun?

Die gegenwärtige und die zunehmende Verwendung von Robotern und künstlichen Agenten in der Zukunft haben für uns wichtige moralische und ethische Anliegen hervorgebracht. Einige Entscheidungsprozesse beinhalten moralische Urteile, die uns Menschen selbst manchmal enorm vor schwierigen Herausforderungen stellen können. Viel zu oft ist es fast unmöglich, eine Lösung für ein moralisches Dilemma zu finden. Manche argumentieren aber, künstliche Akteure gerade deswegen zu bauen, damit diese Arten von Dilemmata für uns gelöst werden können. Aber werden wir jemals in der Lage sein, künstliche Intelligenz zu schaffen, die die moralischen Dilemmata für uns lösen werden? Genau das verstärkt die Herausforderung, moralische und ethische Werte wie auch immer in die Software der Computer einbetten zu müssen.

Es ist offensichtlich, dass einige Akteure künstlicher Intelligenz irgendwann in der nahen Zukunft Entscheidungsprozesse in dieser Art durchführen müssen. In der Tat ist es unserer Forschung zufolge möglich, dass wir dieselben motorischen Handlungen ausführen können – wie unser Experiment eines harmlosen Gähnens, das ein moralisch und ethisch unbewusster Android geschaffen hat. Wenn es also die Möglichkeit gibt, die Handlungen einer künstlichen Intelligenz unbeabsichtigt nachzuahmen, bedeutet dies dann, dass wir unsere eigenen Fähigkeiten beschränken oder kontrollieren müssen?

Ramiro Martin Joly-Mascheroni (IT) ist Doktorand der Psychologie, der erforscht, wie blinde Kinder und Erwachsene Handlungen wahrnehmen. Aus vergleichender und evolutionärer Sicht untersucht er, wie sich die menschliche Wahrnehmung von Handlungen von der tierischen unterscheidet. Er hat dafür einen Androiden und eine Reihe anderer Tools entwickelt, die von blinden Menschen und Schlaganfallopfern verwendet werden, um ihre eigenen Gesichtsausdrücke zu trainieren, zu rehabilitieren und sie wieder zu kontrollieren. Diese Tools helfen auch bei der Deutung von Gesichtsausdrücken Anderer durch Biofeedback-Systeme.