Großer Beifall im Publikum schon bevor es losgeht. Ein Mann betritt die in bunte Lichter getauchte Bühne und schreitet zum Mikrofonständer in der Mitte der Plattform. Das Intro ertönt, der Sänger wiegt sich in den Takten der elektronischen Musik. Dass das kein gewöhnliches Live-Konzert ist, das wird spätestens beim ersten Erklingen seiner Stimme klar, die nicht seine ist. Es ist die Stimme der Künstlerin Holly Herndon, die hier live von einer KI übersetzt zu hören ist (ab Minute 34:12).

Die Stimme einer anderen Person ergreifen, das ist dank Holly Herndon und ihrem Projektteam an „aufgeschlossenen Menschen“, wie sie sie gerne bezeichnet, keine Zukunftsmusik mehr. „Holly+“, für das sie kürzlich mit dem STARTS Prize 2022 ausgezeichnet wurde und das in Zusammenarbeit mit Herndon Dryhurst Studio, Never Before Heard Sounds und Voctro Labs entstanden ist, ist eine wahre Meisterleistung dessen, was maschinelles Lernen im Musikbereich heutzutage bereits möglich machen kann.

Ob als vorab aufgezeichnete Audiodatei über die Website holly.plus oder wie hier als Live-Performance: Jede und jeder, die oder der möchte, kann sich Holly‘s Stimme ausborgen, um selbst damit Musik zu machen. Dank der rund um das Projekt aufgebauten dezentralen autonomen Organisation „Holly+ DAO“ können Musiker*innen nicht nur ihre Stimme nutzen und damit Geld verdienen, sondern finanzieren damit auch die Weiterentwicklung dieser Instrumente und übernehmen die Rolle des Kontrollorgans, wenn es um die angemessene Nutzung ihres digitalen Zwillings geht.

Gleich zu Beginn… Es gab auch eine Zeit, in der du keinen digitalen Zwilling hattest – gab es für dich einen bestimmten Auslöser, diesen zu schaffen, oder hat sich das im Laufe der Zeit so entwickelt?

Holly Herndon: Holly+ ist aus verschiedenen Experimenten entstanden, an denen ich für mein Album PROTO gearbeitet habe. Mein Partner und ich haben zusammen dazu mit einem Ensemble in Berlin ein KI-Baby aufgezogen, das wir Spawn nannten. Spawn lernte aus einer Kombination des „Trainingsmaterial“ dieser Gesangsgruppe. Als die Tools immer ausgereifter wurden, erkannten wir, dass wir ein naturalistisches Abbild schaffen konnten, und die einzige Lösung, bei der wir uns wohlfühlten, war das direkte Training mit uns selbst. Zu diesem Zeitpunkt begann ich, meine eigenen Trainingsdaten zu verwenden, und Holly+ war geboren.

Jetzt können auf einmal andere Menschen, die du vielleicht gar nicht kennst, mit deiner Stimme sprechen und singen. Wie fühlt es sich eigentlich an, die eigene Stimme an andere Menschen weiterzugeben?

Holly Herndon: Das Projekt hat sich ja in mehreren Phasen weiterentwickelt. Unser erstes Instrument modelliert die „Essenz“ meiner Stimme, ist aber nicht naturgetreu. Das zweite Instrument, an dem wir arbeiten, ist hingegen viel naturalistischer, und wir haben Schutzmechanismen für Nutzung dieses Tools geschaffen. Letztendlich wird es aber für jeden frei zugänglich sein.

Aber da die Weiterentwicklung immer wieder in kleinen Schritten geschieht, habe ich genug Zeit, um Probleme zu erkennen, die dabei auftreten, und mich an diesen Gedanken zu gewöhnen. Wenn eine andere Person mit meiner Stimme auftritt, bin das natürlich nicht wirklich ich. Es ist diese Person, die sich durch mich ausdrückt, oder durch einen Teil meiner Identität. Ich finde das extrem spannend, weil dadurch eine Mischung entsteht, die vorher nicht möglich war. Die Entscheidungen, die der oder die Darsteller*in trifft, sind natürlich andere als meine eigenen.

In deinem Projekt sprichst du vom Spiel mit der Identität – was bedeutet Identität eigentlich für dich?

Holly Herndon: „Identity Play“ bedeutet für mich, dass ich anderen Menschen erlaube, mein digitales Abbild mit Hilfe von Machine-Learning-Tools, die mit Informationen über mich trainiert wurden, spielerisch einzusetzen. Dies kann mit meiner Stimme oder mit meinem visuellen Abbild geschehen. Identität ist ja sowohl konstruiert als auch vererbt. Ich ziehe es lieber vor, mich auf die Aspekte der Konstruktion zu konzentrieren!

Du verwendest Klang als Material, kopierst mit Künstlicher Intelligenz die menschliche Stimme und überträgst sie auf andere Menschen. Ist es das, was die Musikindustrie und alle Urheberrechtsfragen in naher Zukunft komplett auf den Kopf stellen wird?

Holly Herndon: Die Musikindustrie und das Urheberrecht sind in jedem Fall veränderungsbedürftig, aber natürlich wird Machine Learning einen tiefgreifenden Einfluss darauf haben. Ich hoffe, dass wir aus den Fehlern der Vergangenheit in Bezug auf das Sampling lernen und einen Weg finden können, der das Experimentieren und die Kreativität fördert und gleichzeitig die Menschen fair entlohnt, die sich am Erstellen der Trainingsdaten beteiligen.

Ich glaube, dass viele in der Kunst erst ein umfassendes Verständnis für die Möglichkeiten der neuen Technologien von Machine Learning entwickeln müssen, denn während ich daran glaube, dass es so viel gibt, worüber man sich hier freuen kann, denke ich auch, dass die Künstler*innen nicht ausreichend darauf vorbereitet sind, wie dramatisch einige Veränderungen in ihren Gewohnheiten oder ihren finanziellen Einkünften sein können. Ich glaube, viele Menschen sind von den übertriebenen Behauptungen im Zusammenhang mit dieser Technologie überwältigt, aber das ist etwas anderes. Das ist keine Probe.

Holly+ enthält Instrumente, die mit dem Herndon Dryhurst Studio, Never Before Heard Sounds und Voctro Labs entwickelt wurden. Wie kam es zu dieser Zusammenarbeit?

Holly Herndon: Mein Partner Mat Dryhurst und ich beschäftigen uns schon seit Jahren mit Machine Learning und kennen daher viele Leute, die in diesem Bereich tätig sind. Chris und Yotam von NBHS haben wir über die sozialen Medien kennengelernt, und sie haben uns eine Demo geschickt, die sie intern mit einem unserer Songs verwendet hatten, so dass sich die weitere Zusammenarbeit sehr logisch anfühlte.

Wir kannten VoctroLabs, weil wir ihre Vorträge auf YouTube gesehen hatten, und als wir uns an sie wandten, waren sie unglaublich herzlich und es machte Spaß, mit ihnen zu arbeiten. Da sie ihren Sitz in Barcelona haben, konnten wir dort bei Sonar mit den lokalen Sängerinnen Maria Arnal und Tarta Relena auftreten und die Software von VoctroLabs verwenden, was eine großartige Erfahrung war. Man braucht ein Dorf, um etwas Besonderes zu schaffen, und wir sind so glücklich, dass wir aufgeschlossene Menschen gefunden haben, mit denen wir diese Ideen gemeinsam erforschen können.

Wie geht es mit deinem Projekt weiter? Hast du bereits Ideen oder Ziele, die du dir gesetzt hast?

Holly Herndon: Ich arbeite an einem Album, bei dem ich diese neuen Instrumente bereits einsetze, und an weiteren Live-Auftritten. Ich werde diesen Sommer eine Premiere auf dem Helsinki Festival veranstalten, bei der lokale Musiker*innen mit meiner Stimme auftreten werden. Wir sind auch dabei, eine fehlende Infrastruktur aufzubauen, um Künstler*innen die Teilnahme an dem zu ermöglichen, was ich glaube, das uns noch bevorsteht.

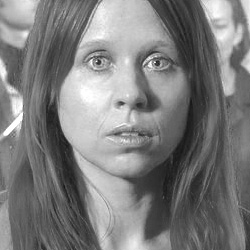

Holly Herndon (US) ist eine amerikanische multidisziplinäre Künstlerin, die in Berlin lebt. In ihrer Arbeit entwickelt sie neue Technologien, um mit ihrer Stimme und ihrem Abbild zu experimentieren, unterstützt durch kritische Forschung im Bereich der Künstlichen Intelligenz und dezentraler Infrastruktur. In jüngster Zeit hat sie ein Instrument entwickelt, mit dem jede*r mit ihrer Stimme singen kann, die Verwaltung ihrer digitalen Stimme an die Holly+DAO übertragen und die Porträtserie „Classified“ veröffentlicht, die aus öffentlich zugänglichen KI-Datensätzen über ihr Konterfei erstellt wurde. Ihre einflussreichen Musikalben PROTO (4AD) und Platform (4AD) hat sie weltweit auf Tournee gebracht, zuletzt mit einem Chor aus menschlichen Stimmen und Stimmen einer Künstlichen Intelligenz. Sie promovierte in Komposition an der Stanford University und arbeitete mit dem Center for Computer Research in Music and Acoustics (CCRMA) zusammen. Sie macht ihren Forschungsprozess durch den Interdependence-Podcast öffentlich.